많은 사람들이 챗GPT의 놀라운 기능에 찬사를 보내고 있지만, 일각에서는 회의적인 목소리가 들려옵니다. 특히 얼마 전 이탈리아에서 챗GPT의 사용을 전면 금지시키면서 불안감이 더욱 커지는 모양새입니다. 이렇게 일부 국가에서는 금지까지 시키고 있는데 챗GPT, 과연 안전한 건 맞나요?

ChatGPT에 대한 각종 소문

챗GPT는 2022년 11월에 출시된 챗봇이며, 사용자가 입력한 내용에 대해 대화체로 된 답변을 생성해주는 것이 특징입니다. 출시된지 이제 고작 만 4개월 정도 지난 시점이지만 보안과 관련된 각종 논란이 끊이지 않고 있습니다. 논란이 되고 있는 내용은 다음과 같습니다.

식별 가능한 개인정보의 수집 및 저장

오픈 AI사에 따르면 챗GPT는 오픈AI사가 개인정보 보호정책에 명시하고 있는 챗봇 서비스를 제공하는 영역에 한해 고객 데이터를 이용하고 있습니다. 챗GPT가 대화형 답변을 출력할 수 있게 하고자 웹 상에 공개되어 있는 각종 '공공' 정보를 데이터화하여 학습시켰고, 이렇게 데이터 학습을 위해서만 각종 정보를 이용하고 있다는 것입니다. 이 지점에서 고객들이 우려하는 것은 실제로 쳇GPT가 학습한 데이터 중에 다양한 개인정보가 포함되어있을 수 있다는 점입니다. 인터넷에 올라가있는 정보 중에는 사람들이 실수로 올린 개인정보도 있고, 경품 당첨자 발표 등을 위해 쓰인 개인정보도 있고, 어디에선가 해킹되어 유출된 개인정보도 있습니다. 그런데 이렇게 개인정보가 곳곳에 포함되어 있었더라도 쳇GPT는 그것을 단순히 '정보 데이터'로만 인식하고 있는 그대로 학습했을 것이고, 개인정보로 보인다고 해서 스스로 암호화 시키거나 따로 분류하지는 않았을 거라는 것입니다. 이렇게 누군가의 개인정보를 무분별하게 학습해둔 상태인데 누군가가 나쁜 의도를 가지고 챗GPT로부터 각종 개인정보를 얻어내는 프롬프트를 찾아내기라도 한다면, 생각만 해도 아찔합니다.

공공 정보의 수집 및 저장

위에서는 식별 가능한 개인정보 관련 논란을 다루었지만, 꼭 신용카드 번호나 집 주소와 같은 개인정보가 아니더라도 인터넷 상에 올린 정보라면 챗GPT가 언제든 수집 및 저장할 수 있습니다. SNS에 올린 일상 이야기, 온라인 쇼핑몰에 남긴 댓글 등이 모두 포함되며, 이러한 내용 역시 챗GPT가 가져다가 학습용 데이터로서 이용할 수 있는 것입니다. PC로든 휴대폰으로든, 일상적인 수준으로든 비즈니스 수준으로든 인터넷을 이용하고 있는 사람이라면 모두 해당되며, 이용하고 있는 모든 사이트에서 탈퇴하는 등 디지털 발자국을 일부러 지우고 산 게 아니라면 챗GPT가 이미 정보를 갖고있을 확률이 높습니다.

대화 모니터링

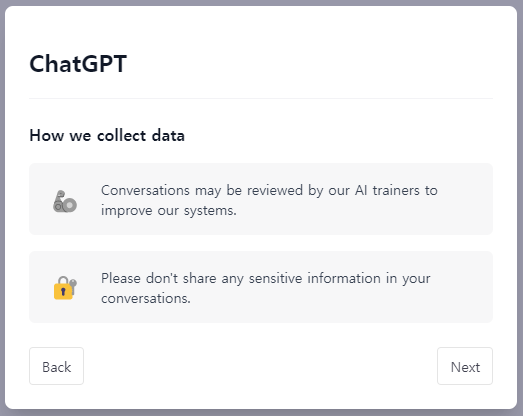

오픈AI사도 그렇고 대화형 서비스를 제공하고 있는 AI 관련사들은 답변의 품질 유지 및 성능 개선을 위해 꾸준히 대화 내용을 모니터링하고 있습니다. 각종 오류나 버그, 취약성을 해결하기 위해 어떻게 보면 당연히 지녀야 하는 권리가 되기도 합니다. 출력물을 명확히 확인할 수 있어야만 문제를 해결할 수 있기 때문입니다. 이와 관련하여 OpenAI사는 연구 목적으로 대화를 모니터링할 수 있다고 이야기하고 있으며, 대화 내용을 제3자에게 배포하거나 판매하고 있지는 않다고 합니다.

이 부분에 대해서도 사용자 입장에서는 걱정을 할 수밖에 없습니다. 아무리 성능 개선을 위한 일이라 하더라도 결국 사용자가 작성한 정보가 언제든 오픈AI사 직원에 의해 열람될 수 있는 게 되기 때문입니다. 사용자가 신용카드 정보나 비밀번호 등을 실수로 챗GPT에 복붙했다 하더라도, 챗GPT의 출력물로서 암호화 없이 언제든 열람될 수 있는 데이터로서 챗GPT 서버에 남게 됩니다. 사용자가 입력한 내용에 자칫 회사의 기밀정보가 포함되어 있다면, 그 내용도 마찬가지로 고스란히 오픈AI사 측으로 넘어가게 됩니다. 챗GPT 측에서 필요로 한다면 마찬가지로 언제든 열어볼 수 있는 데이터로서 축적됩니다. 사용자 입장에서는 고의가 아니었더라도 회사 기밀을 유출한 게 되는 것입니다.

오늘의 결론

위와 같은 각종 논란에 대해 오픈AI사 측에서도 명확한 답변을 내놓지 않고 있다는 점은 아쉽습니다. 딥러닝 형태로 데이터를 학습하는 기계의 문제는, 그걸 지켜보는 인간도 정확히 그 기계가 어떤 방식으로 데이터를 학습하는지 모른다는 것에 있습니다. 챗GPT도 예외는 아니겠고, 오픈AI 쪽에서도 정확히 챗GPT가 학습한 데이터를 어떻게 처리하고 있는지 100% 완벽히 알 수 있는 것은 아니기에 답변을 못하고 있는 것일지도 모릅니다.

물론 챗GPT를 이용하는 것 자체가 위험한 것은 아닐 겁니다. 문제는 이러한 인공지능 서비스가 아닌, 이를 악용하는 사람들입니다. 하지만 세상에 나온지 얼마 되지 않은 서비스이기도 하고 취약점을 계속 고쳐나가고 있는 시점인 것도 맞으니, 사용하면서 문제가 될만한 정보는 최대한 챗GPT에 입력하지 않는 것이 좋겠습니다. 그냥 챗GPT에 입력하는 정보는 누구나 열람 가능한 '공공 정보'가 된다고 생각하고 쓰는 게 마음 편할지도 모르겠습니다. 챗GPT 뿐만 아니라 웹 상의 데이터를 긁어와 학습하고 대화형 답변을 생성하는 서비스를 이용할 땐 동일하게 주의를 기울이고, 개인정보를 스스로 능동적으로 보호하는 것이 필요하겠습니다.

'챗GPT 101' 카테고리의 다른 글

| 챗GPT 입력창 여러줄 입력 방법 (0) | 2023.04.13 |

|---|---|

| 챗GPT 계정 삭제 방법, 탈퇴 절차 (0) | 2023.04.11 |

| 챗GPT 유료 결제 취소하는 방법 (0) | 2023.04.10 |

| 이탈리아가 챗GPT를 차단시킨 이유는? 다른 나라는? (0) | 2023.04.10 |

| 챗GPT 앱 설치, 크롬이나 엣지로 쉽게 하는 방법 (0) | 2023.04.09 |

댓글