챗GPT는 인간이 작성한 콘텐츠를 모방하기 위해 자연어 텍스트를 생성하는 기술입니다. 머신러닝과 딥러닝 알고리즘을 기반으로 대량의 데이터를 학습하는 것이 핵심 기술인데, 이를 통해 실제로 인간이 작성한 것과 유사한 콘텐츠를 만들어냅니다.

챗GPT의 기술력은 아마 지금 이 순간에도 진보하고 있을테고 시간이 지날수록 정교함은 높아질 수밖에 없을 겁니다. 챗GPT의 정교함이 높아질수록 챗GPT가 생성하는 콘텐츠와 인간이 생성한 콘텐츠를 구별하는 것도 어려워지지 않을까 합니다. 그에 대한 대응책이 있을까요? 구글과 같이 광고 비즈니스를 보유한 서비스들은 광고 지면의 퀄리티가 어느 정도 보장되어야 광고주들에게 지면 판매가 가능할테니, 저품질 콘텐츠를 더 잘 걸러내고 싶어하지 않을까요? 이번 글에서는 이에 대해 생각해보는 자리를 마련해보고자 합니다.

챗GPT의 답변은 대체로...

챗GPT를 쓰다 보니 챗GPT의 답변에서 일종의 패턴이 느껴지는 경우가 있기는 합니다. 주제를 하나 정하고 그에 대해 설명해달라고 하면 대체로 서론-본론-결론의 형태로 정리해 준다거나, 예시를 알려달라고 하면 모든 예시에 숫자를 매겨 알려준다거나 하는 경우입니다.

이런 패턴만으로 챗GPT가 작성한 글을 걸러낼 수 있을까요?

일단 챗GPT가 제시한 최초의 답변을 어떠한 가공도 없이 고스란히 갖다 쓴 콘텐츠라면 위에서 설명한 패턴을 그대로 갖고있을 확률이 높아 보입니다. 제가 저품질 콘텐츠를 걸러내는 툴을 만든다면 먼저 이렇게 패턴이나 반복이 있는 콘텐츠부터 먼저 찾아내고, 이어서 그 콘텐츠가 실제로 기계가 쓴 게 맞는지를 분석해보는 절차를 거치게 될 것 같습니다.

하지만 본인이 올린 콘텐츠가 걸러내지지 않게 하려는 의도가 있는 사람이라면, 어떤 식으로라도 챗GPT의 답변을 가공하거나 새로 쓰는 절차를 거치지 않을까 합니다. 사람이 쓴 것처럼 일관된 구조와 패턴을 일부러 없앨수도 있겠고요. 그럼 걸러내질 확률이 상당히 낮아지겠습니다.

챗GPT도 답변 속 패턴의 존재를 인지하고 있을까

혹시 챗GPT도 이런 패턴과 반복에 대해 인지하고 있는지가 궁금해집니다. 챗GPT도 글 속 패턴을 인식하고 있다면 그걸 제거하는 것도 어려운 일이 아닐테니까요. 우선 임의의 기사 하나를 써달라고 했습니다. 아래는 챗GPT가 실제로 만들어낸 뉴스 기사 예시입니다.

제목: 인공지능이 기자의 일을 대체할 수 있을까? 전문가들의 의견을 들어보다.

서울 - 최근 인공지능 기술의 발전으로 기존의 뉴스 기자들의 일자리가 위협받고 있다. 기술적으로 가능한 한계를 넘어, 심지어 인공지능 기술이 사람보다 더 빠르게 뉴스를 작성할 수 있는 상황에서, 인공지능이 기자의 일을 대체할 수 있을까에 대한 논의가 이어지고 있다.

인공지능이 기자의 일을 대체할 수 있는지에 대한 전문가의 의견은 다양하다. 인공지능 기술은 이미 신문사들과 미디어 기업들에서 사용되고 있지만, 인공지능이 취재나 보도 업무에서 완전히 대체될 수 있는지는 아직 불분명하다.

서울대학교 컴퓨터공학부 교수 이철희 교수는 "인공지능이 자동으로 뉴스를 작성하는 것은 가능하지만, 기사 작성에 필요한 사실 확인, 논리적 추론, 윤리적 고민 등 인간적인 역할을 대체할 수 없다"라고 말했다.

한편으로 인공지능 기술은 데이터 분석, 자동번역 등 다른 분야에서 유용하게 활용될 수 있다. 따라서, 미디어 산업은 이러한 기술적 변화에 적극 대응하여 새로운 방식으로 뉴스를 제공하는 방법을 모색해야 한다.

이번엔 위의 기사가 왜 AI가 작성한 것처럼 들리는지를 물어봤습니다.

챗GPT가 스스로 쓴 기사글임에도 불구하고 그게 어떠한 이유로 AI가 작성한 것처럼 들릴 수 있는지를 상세하게 분석하고 있습니다. 챗GPT가 이렇게 AI가 쓴 글이 어떻게 생겼는지를 이미 인지하고 있다는 건 챗GPT가 마음만 먹으면, 그리고 사람이 제대로 된 질문과 요청만 한다면, 패턴이나 반복이 들어가지 않은 글을 얼마든지 써낼 수 있다는 뜻이 됩니다. 최초 질문이나 요청에 대한 첫 번째 답변에만 편의 상 패턴이 있어왔던 것이지, 그 이후의 답변은 얼마든 'AI가 쓴 티가 안나게' 가공이 가능하다는 의미입니다.

이번에는 혹시 좀 더 전문적인 글에 대해서도 분석이 가능한지 확인해보고자, 임의의 과학 논문을 한 편 써달라고 해봤습니다.

"GPT-3 언어 모델이 감성 분석에 미치는 영향"

본 논문에서는 GPT-3 언어 모델이 감성 분석에 미치는 영향에 대해 조사하고자 합니다. 최근에는 대규모 텍스트 데이터셋에서 pre-training된 GPT-3 언어 모델이 자연어 처리 분야에서 높은 성능을 보이고 있습니다. 이러한 모델이 감성 분석 분야에서도 높은 성능을 보이는지 확인해 보고자 합니다.

본 연구에서는 먼저 GPT-3 모델을 이용하여 감성 분석 데이터셋을 학습시키고, 그 결과를 기존의 감성 분석 모델과 비교해 보았습니다. 이를 통해 GPT-3 모델이 감성 분석 분야에서 높은 성능을 보이는 것을 확인할 수 있었습니다.

또한, GPT-3 모델이 감성 분석에서 성능을 높이는 데에 기여하는 요인에 대해 분석해 보았습니다. 이를 통해 GPT-3 모델이 다른 언어 모델과 비교해 더 나은 문맥 파악 능력과 더 다양한 감성 표현을 제공하는 것이 성능 향상에 기여하는 것으로 나타났습니다.

마지막으로, GPT-3 모델이 감성 분석 분야에서의 적용 가능성에 대해 논의해 보았습니다. GPT-3 모델이 다른 분야에서도 높은 성능을 보이는 것을 감안할 때, GPT-3 모델은 감성 분석 분야에서도 매우 유용한 도구가 될 수 있다는 결론을 도출할 수 있었습니다.

이어서, 챗GPT에게 위의 예시가 왜 AI가 쓴 것처럼 들리는지를 물어봤더니 아래와 같이 대답했습니다.

위의 뉴스 기사 예시에서와 마찬가지로, 챗GPT는 이미 알고 있습니다. 챗GPT가 학습한 데이터 속에는 'AI는 이런 식으로 글을 쓴다'와 '사람은 이런 식으로 글을 쓴다'는 나름의 정의가 이미 담겨있던 것입니다. 그렇습니다, 그렇게 방대한 데이터 속에 그런 내용만 쏙 빠져있었을 리는 없었겠습니다.

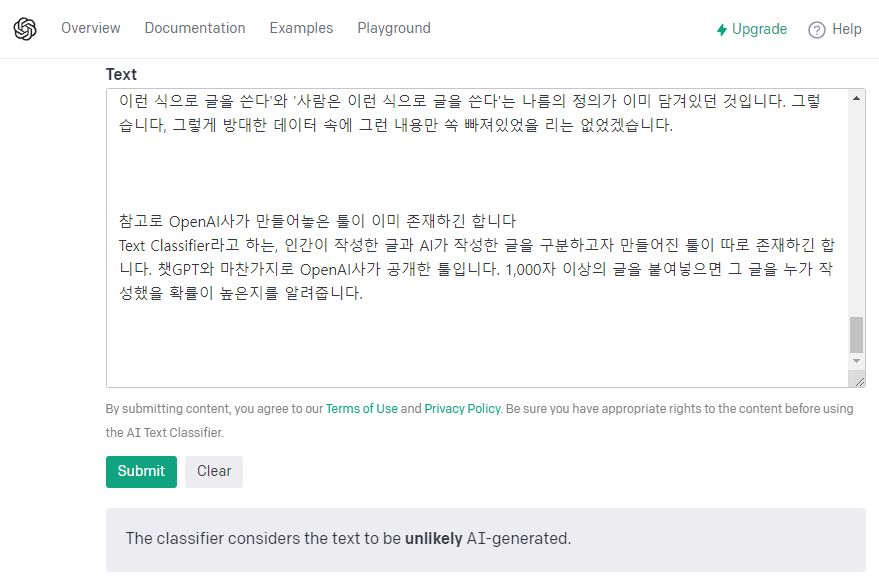

참고로 OpenAI사가 만들어놓은 툴도 이미 존재하긴 합니다

Text Classifier(텍스트 분류기)라고 하는, 인간이 작성한 글과 AI가 작성한 글을 구분하고자 만들어진 툴이 따로 존재하긴 합니다. 챗GPT와 마찬가지로 OpenAI사가 공개한 툴입니다. 1,000자 이상의 글을 붙여넣으면 그 글을 누가 작성했을 확률이 높은지를 알려줍니다.

분류 결과는 총 다섯 가지로 확인 됩니다.

- The classifier considers the text to be likely AI-generated. / 분류기는 이 텍스트가 AI로 생성되었을 가능성이 높다고 판단합니다.

- The classifier considers the text to be possibly AI-generated. / 분류기는 이 텍스트가 AI로 생성되었을 가능성이 높다고 판단합니다.

- The classifier considers the text to be unclear if it is AI-generated. / 분류기는 이 텍스트를 AI가 생성했는지 불분명하다고 판단합니다.

- The classifier considers the text to be unlikely AI-generated. / 분류기는 이 텍스트가 AI로 생성되지 않았을 가능성이 높다고 판단합니다.

- The classifier considers the text to be very unlikely AI-generated. / 분류기는 이 텍스트가 AI로 생성되지 않았을 가능성이 매우 높다고 판단합니다.

위에서 챗GPT가 임의로 만들었던 기사 글과 그에 대한 제 평을 붙여넣고 결과를 보면 제가 쓴 글의 비중이 높아질수록 사람이 쓴 글로 인식하고 있습니다.

이를 보아도, 사람이 마음만 먹으면 챗GPT의 생성물을 어떻게 해서든 인간이 쓴 것처럼 보이게 만들 수 있다는 뜻이 되겠네요.

위 툴 외에 Giant Language model Test Room이라고 하는 툴도 있고, 알게 모르게 이런 툴들이 이미 여기 저기 존재하고 있으니 결국 누구의 어떤 기술이 더 빠르게 진화하느냐가 중요해 지겠습니다.

구글은 왜 인공지능이 만든 콘텐츠를 걸러내고 싶어할까

우선 구글은 유저들이 구글을 이용할 때 최상의 경험을 하길 바랍니다. 이건 어느 회사건 동일할 겁니다. 자사의 제품이나 서비스를 경험한 고객들이 그 제품이나 서비스를 긍정적으로 평가하고, 이탈 없이 꾸준히 자사 고객으로 남길 바라는 것입니다. 검색엔진인 구글은 검색 결과를 제공하는 데 있어 유저들이 최대한 신속하고 정확하게 필요한 정보를 찾게 하고자 합니다. 이러한 이유로 구글은 인공지능 서비스들이 나오기 훨씬 전부터 이미 퀄리티가 낮아보이는 콘텐츠 즉 유저 경험에 도움이 안되는 콘텐츠를 걸러내기 위한 다양한 방법을 지속적으로 모색해 왔습니다.

그리고 이유는 하나 더 있습니다. 앞에서 언급한것과 같이 구글은 광고 비즈니스를 보유하고 있습니다. 구글에게 돈을 벌어다주는 주력 비즈니스 중 하나가 광고이며 그만큼 광고주들이 구글에 꾸준히, 많은 돈을 쓰게 하는 것이 굉장히 중요합니다. 그리고 광고주들이 계속 돈을 쓰게 하려면 광고를 노출시키는 지면의 퀄리티 또한 굉장히 중요해집니다. 광고주들은 자사에서 공을 들여 만든 제품을 '가치 없는' 콘텐츠 사이에서 광고하는 것을 폭력성이나 선정성이 짙은 콘텐츠 사이에서 광고하는 것만큼 싫어합니다. 저품질 콘텐츠 사이에 자사 광고가 노출된 것을 알게되는 광고주는 해당 지면을 차단시키거나, 심한 경우 구글 등 매체 측에 항의하기도 합니다. 이러한 이유들이 있기에 구글이 저품질 콘텐츠를 찾고 걸러내는 것에 주력하고 있는 것은 당연합니다.

결국은 기술과 기술의 싸움, 혹은 인간의 잔머리와 기술의 싸움

구글과 같이 광고 비즈니스를 운영하고 있는 대형 플랫폼들이 어떤 식으로 챗GPT가 대량 생산해내는 저품질 콘텐츠를 걸러내는 기술을 개발하고 있는지 현재로선 (저는) 알 수 없습니다. 실제로 2023년 2월 현재까지 아직 구글의 공식적인 입장이 있었던 적도 없었습니다. 사람이 만들어내는 컨텐츠가 워낙 다양하고 방대하여 어떤 수식이나 패턴만을 토대로 한 필터링에는 한계가 있기에, 아직까지는 사람이 직접 일일히 수동으로 걸러내는 게 더 많다는 소문은 있습니다. 한편으로는 어쩌면 소문과는 다르게 이미 챗GPT가 일반인에게 공개된 지난 12월 경부터 어느 정도 챗GPT의 콘텐츠를 감지하고 필터링하고 있었을지도 모릅니다.

그쪽 기술은 앞으로도 최대한 다량의 저품질 콘텐츠를 빠르게 필터링하는 방향으로 진화할테고, 챗GPT쪽의 기술은 최대한 다량의 고품질 콘텐츠를 빠르게 생성해내는 방향으로 진화하겠고, 결국은 기술들 간의 싸움이 되겠습니다. 일단 저는, 챗GPT쪽에 한 표입니다. 필터는 계속 촘촘해지겠지만 챗GPT의 기술 역시 지속적으로 정교해질 것이고, 설령 필터의 진화 속도가 조금 더 빨라지더라도 인간의 잔머리는 어떻게 해서든 그 필터를 뚫는 편법을 생각해낼 거라고 봅니다.

챗GPT가 불러올 각종 변화, 웹 및 블로그 생태계 변화, 컨텐츠 평준화, AI 작가, 데이터 중립성

챗GPT 공부에 빠져들고 챗GPT가 너무 재미있어지면서 이 블로그를 시작했습니다. 챗GPTing(제 마음대로 뒤에 ing를 붙인 단어입니다)의 기쁨을 많은 사람들과 나누고 싶다는 생각이 들어서였습니다.

chatgptjoy.tistory.com

'챗GPT 101' 카테고리의 다른 글

| 챗GPT로 인해 사라질 직업들, 영향이 덜할 직업들 (0) | 2023.02.23 |

|---|---|

| 챗GPT란? 작동 원리, 일론머스크 참여, GPT 시리즈, 활용 사례, 사용하는 이유와 장점 (0) | 2023.02.22 |

| 챗GPT를 활용한 키워드 추출, 키워드 분석, 캠페인 목표 KPI 설정, 소재 생성 (0) | 2023.02.22 |

| 챗GPT의 카피라이팅 퀄리티 높이기, 프롬프트 가공 방법, 예시 (0) | 2023.02.22 |

| 챗GPT가 네이버 지식IN을 위협하는 날이 올까 (0) | 2023.02.21 |

댓글